OpenClaw:住在我家裡的 AI

你現在讀到的這篇文章,有一部分是由我即將介紹的系統寫出來的、翻譯成三種語言、排好格式、然後發佈的。

不是比喻。草稿由自動化流程生成,經過人工審核後提交。我看了一眼,批准了,合併了。這就是我全部的參與程度。

所以從這裡開始,感覺挺合適的。

協調問題

用了上一篇裡提到的工具幾個月之後,另一種摩擦感出現了。

不是存取問題。不是付款問題。是協調問題。

Claude 不知道 Perplexity 上週找到了什麼。Perplexity 不知道我在建置什麼。ChatGPT 也不知道。每次對話都從零開始。每個工具都是一座孤島。

用得越多,瓶頸越清晰。不是 AI 的問題。是我,要自己在工具之間讀取資訊、整合來源、手動把一個脈絡裡的資訊傳遞到另一個。

我變成了整合層本身。這不是一份好工作。

OpenClaw 就是替代了這件事的東西。

OpenClaw 是什麼

OpenClaw 是一個開源 AI 代理人執行環境。安裝它,連接模型供應商和各種整合,它就會以持續運作的程式形式跑在你指定的任何機器上。

和聊天介面的區別在於:關掉瀏覽器之後它照樣在跑。你傳訊息給它,它就回應。它還會在你不主動詢問的情況下,自動執行排程任務。

兩種工作模式。觸發式任務:你傳訊息,它做事,然後回報結果。排程任務:它按計時器運行,完成工作,然後把結果輸出到你設好的地方。

對我來說是 Discord。任務完成,結果出現在頻道裡,我去審閱。AI 代理人不會自行發布任何內容——這個邊界是刻意的設計選擇,不是限制。下一篇再詳細說。

怎麼讓它運作起來

大多數設置教學都從錯誤的地方開始講。你不需要家用伺服器。甚至不需要一台備用機器。

家用伺服器

翻出一台舊電腦重新利用就夠了。我的已經跑了好幾個月,沒有任何問題。零雲端費用,資料完全自控,全天候上線。如果你有閒置機器,這是成本最低的路徑。

有一點值得澄清:OpenClaw 剛發布的時候,很多人跑去買 Mac Mini 來跑它。其實完全沒必要。每月幾美元的基礎 VPS 就夠用了。執行環境本身很輕量;機器規格不是關鍵。關鍵是你接上去的模型。Cloudflare 做了 Moltworker 來證明這一點——如果你想在零硬體的情況下運行,完全可以。

設置文件在 OpenClaw repo 裡。簡單說:安裝執行環境,設定模型提供商,連接一個訊息頻道。

雲端

各大雲端服務商現在都有官方部署指南。

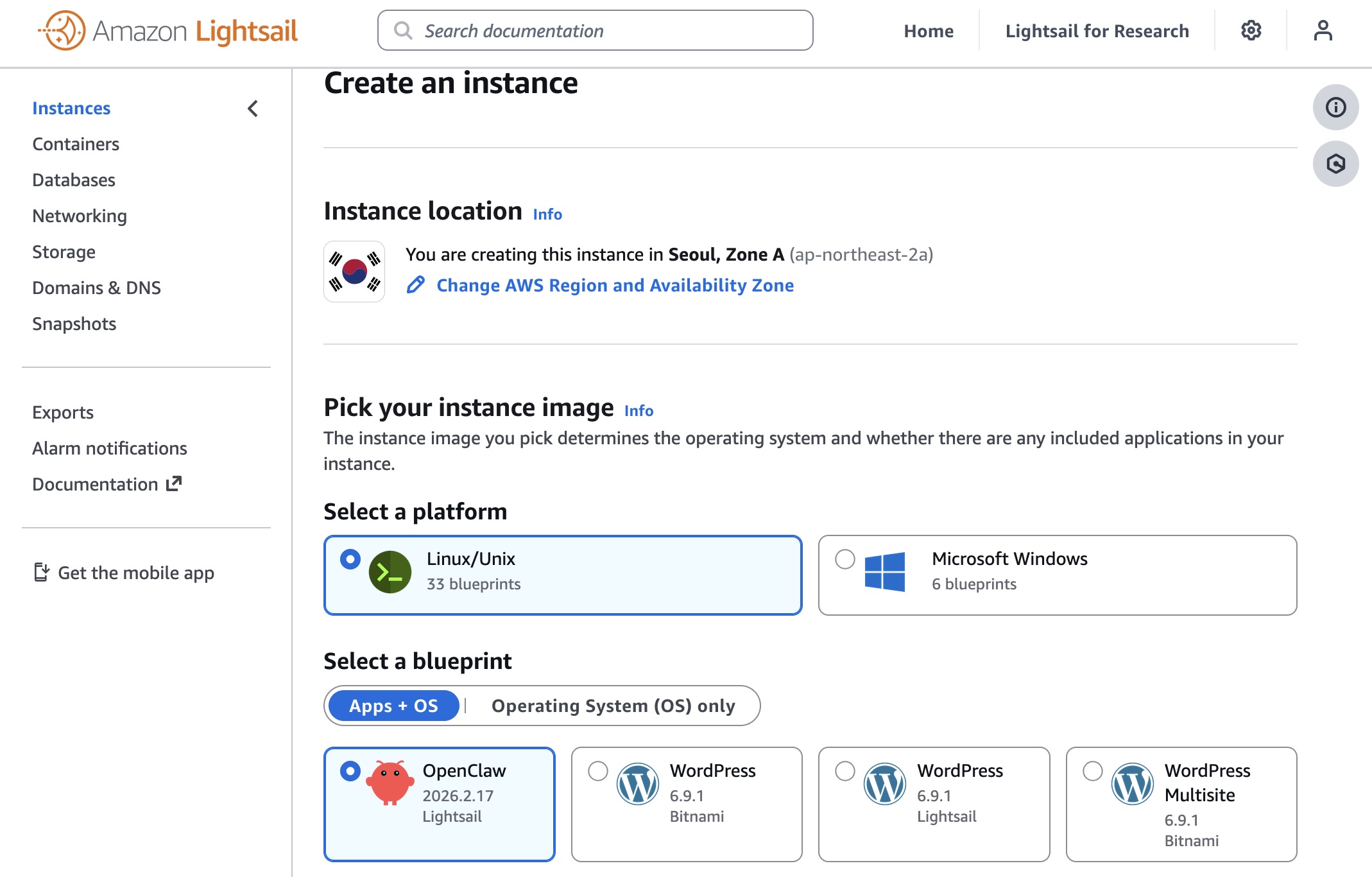

AWS Lightsail 是文件最完善的選項。亞馬遜官方教學:Introducing OpenClaw on Amazon Lightsail。還有 Bedrock 整合範例 repo:aws-samples/sample-OpenClaw-on-AWS-with-Bedrock。

Cloudflare Moltworker 是 Cloudflare 的版本,基於 Moltbot(OpenClaw 底層的開源框架)。不需要伺服器,不需要任何硬體。使用 R2 儲存、Browser Rendering 做網頁自動化、AI Gateway 管理模型路由。需要 Workers Paid 方案(約 $5/月)加上你自己的模型 API 金鑰。資料存放在 Cloudflare,這是需要權衡的地方。github.com/cloudflare/moltworker | 部落格文章。

騰訊雲 一鍵部署:cloud.tencent.com/act/pro/openclaw。

Alibaba Cloud(國際版):deploy OpenClaw on Alibaba Cloud。

阿里雲(中國區):Moltbot on AliYun | Model Studio 指南。和 Alibaba Cloud 是同一家公司,但司法管轄區不同。阿里雲把它叫做 Moltbot——框架一樣,基礎設施在中國大陸。

微信方案

如果你在中國大陸,日常生活已經在微信裡,騰訊 QQ 的 QClaw 是完全跳過部署環節的選擇。AI 代理人就是微信裡的一個聯絡人,直接傳訊息就行。不需要伺服器,不需要任何設定。

騰訊深圳總部當時有逾千人排隊去安裝它。這個數字能說明,零門檻對微信使用者究竟意味著什麼。

模型問題

這是我一開始做錯的地方,也是大多數人低估的地方。

你接上 OpenClaw 的模型,決定了整件事是感覺流暢還是感覺壞掉了。這不是細節問題。

我試過用 GLM 4.7 和 GLM 5.0 處理任務。兩個都是有能力的模型。問題是延遲。Claude 或者 GPT-5.4 幾秒就能回答的問題,它們要整整一分鐘才能返回結果。對聊天介面來說是令人惱火的。對一個全天候運行排程任務、處理你訊息的系統來說,就會徹底崩潰。

失敗是慢慢蔓延過來的。你傳了一條訊息,等著。是在處理?是卡住了?你又試了一次。現在佇列裡有兩個請求了。最終你等了三分鐘才得到一個本來五秒就該完成的事情。到了這一步,這個系統不再有用,只是一個持續製造焦慮的來源。

快速可靠能完成的實際工作,比強大但緩慢更多。這個道理我是搞壞了幾樣東西才真正信的。

高品質任務——寫作、推理、複雜研究——我用 Claude Sonnet,透過 claude.ai 或者 API。這個不能省。

批次任務如分類、摘要、輕量處理,開源模型夠快而且便宜得多:

- 阿里雲 Bailian Coding Plan — GLM-5、Qwen 3.5、Kimi K2.5、MiniMax M2.5;最低付費方案每月最多 90,000 個請求。中國區,阿里巴巴資料政策。

- Alibaba Cloud 同等方案 — 相同模型,國際司法管轄區。

- 騰訊雲 Coding Plan — 類似定價,騰訊基礎設施。

- 偏好留在中國雲端之外:OpenCode Go $10/月,相同模型存取。

需要事實準確的研究,我用 Perplexity Search API。每個答案都有引用來源,不會用聽起來合理的內容填補空白。

在你把任何模型放入定期任務之前:用一個簡單提示詞加計時器測試回應時間。不要依賴 benchmark。你實際買到的是真實條件下的延遲。

是這樣的

當我早上打開 Discord,事情已經發生了。有一份涵蓋我追蹤話題的動態摘要——AI 基礎設施、SRE、Web3、雲端。三個社群帳號的草稿內容。一個我一直在做的私人專案的快照。

全都沒有發佈。全都落在頻道裡。我讀一讀,決定哪些值得用,然後採取行動。

流程裡實際跑的是什麼、每個任務在做什麼、以及一個真實早晨的輸出是什麼樣的:下一篇。

這是關於 AI 工具堆疊系列的一部分。上一篇講存取、付款和訂閱:香港 AI 設置。下一篇講 OpenClaw 實際做什麼——研究流程,以及你醒來之前已經出現的東西。