OpenClaw:住在我家里的 AI

你现在读到的这篇文章,有一部分是由我即将介绍的系统写出来的、翻译成三种语言、排好格式、然后发布的。

不是比喻。草稿由自动化流程生成,经过人工审核,提交到代码库。我看了一眼,批准了,合并了。这就是我全部的参与程度。

所以从这里开始,感觉挺合适的。

协调问题

用了上一篇里提到的工具几个月之后,另一种阻力出现了。

不是访问问题。不是付款问题。是协调问题。

Claude 不知道 Perplexity 上周找到了什么。Perplexity 不知道我在构建什么。ChatGPT 也不知道。每次对话都从零开始。每个工具都是一座孤岛。

用得越多,瓶颈越清晰。不是 AI 的问题。是我,要自己在工具之间读取信息、整合来源、手动把一个上下文里的信息传递到另一个。

我变成了集成层本身。这不是一份好工作。

OpenClaw 就是替代了这件事的东西。

OpenClaw 是什么

OpenClaw 是一个开源 AI 智能体运行环境。安装它,连接模型提供商和各种集成,它就会以常驻进程的形式跑在你指定的任何机器上。

和聊天界面的区别在于:关掉浏览器之后它照样在跑。你发消息给它,它就响应。它还会在你不主动询问的情况下,自动执行定时任务。

两种工作模式。触发式任务:你发消息,它做事,然后汇报结果。定时任务:它按计时器运行,完成工作,然后把结果输出到你设好的地方。

对我来说是 Discord。任务完成,结果出现在频道里,我去审阅。智能体不会自行发布任何内容——这个边界是刻意的设计选择,不是限制。下一篇再详细说。

怎么把它跑起来

大多数设置教程都从错误的地方开始讲。你不需要家用服务器。甚至不需要一台备用机器。

家用服务器

翻出一台旧电脑重新利用就够了。我的已经跑了好几个月,没有任何问题。零云端费用,数据完全自控,全天候在线。如果你有闲置机器,这是成本最低的路径。

有一点值得澄清:OpenClaw 刚发布的时候,很多人跑去买 Mac Mini 来跑它。其实完全没必要。每月几美元的基础 VPS 就够用了。运行环境本身很轻量;机器规格不是关键。关键是你接上去的模型。Cloudflare 做了 Moltworker 来证明这一点——如果你想在零硬件的情况下运行,完全可以。

设置文档在 OpenClaw repo 里。简单说:安装运行环境,配置模型提供商,连接一个消息频道。

云端

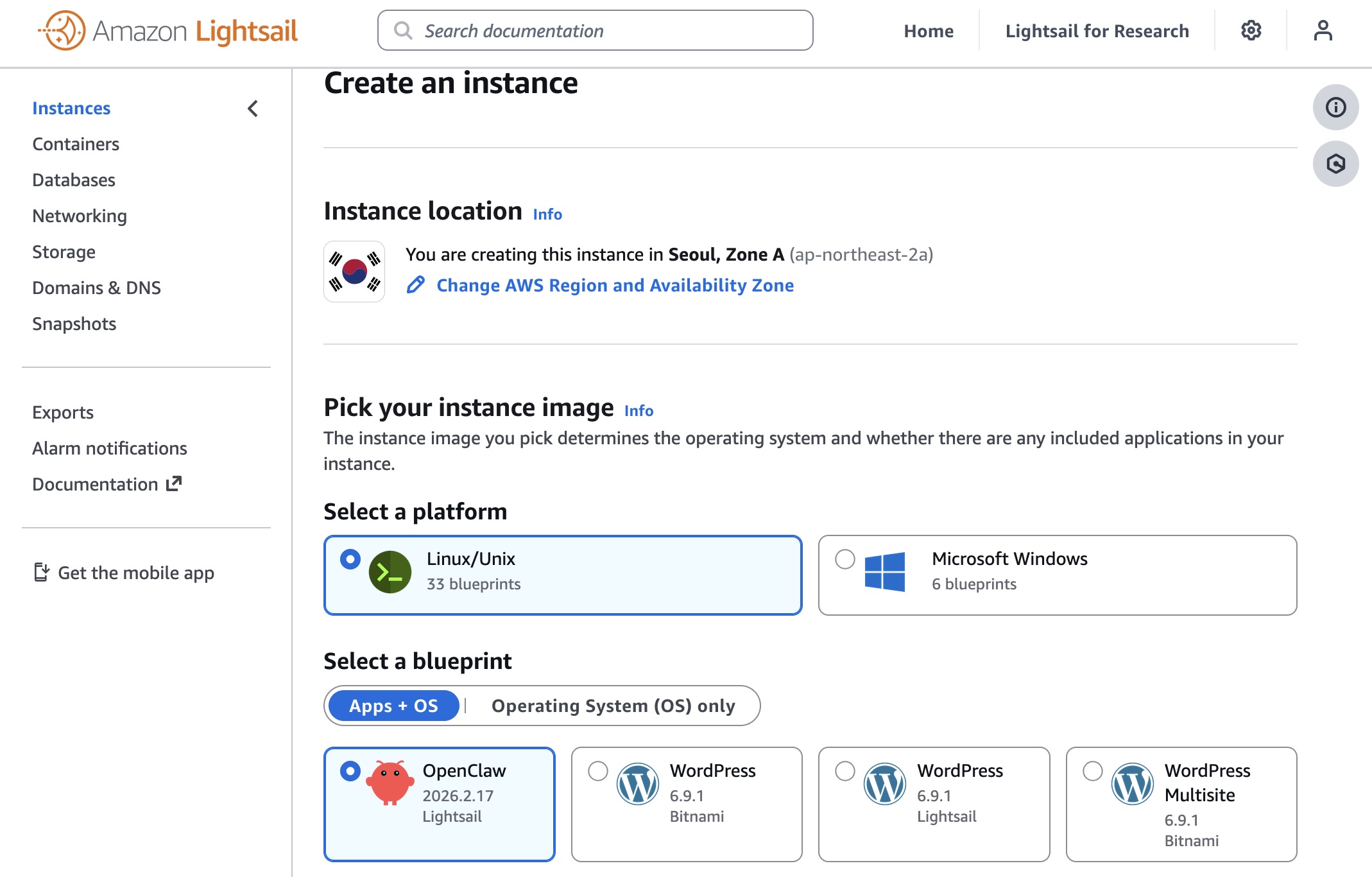

各大云服务商现在都有官方部署指南。

AWS Lightsail 是文档最完善的选项。亚马逊官方教程:Introducing OpenClaw on Amazon Lightsail。还有 Bedrock 集成示例 repo:aws-samples/sample-OpenClaw-on-AWS-with-Bedrock。

Cloudflare Moltworker 是 Cloudflare 的版本,基于 Moltbot(OpenClaw 底层的开源框架)。不需要服务器,不需要任何硬件。使用 R2 存储、Browser Rendering 做网页自动化、AI Gateway 管理模型路由。需要 Workers 付费套餐(约 $5/月)加上你自己的模型 API 密钥。数据存放在 Cloudflare,这是需要权衡的地方。github.com/cloudflare/moltworker | 博客文章。

腾讯云 一键部署:cloud.tencent.com/act/pro/openclaw。

Alibaba Cloud(国际版):deploy OpenClaw on Alibaba Cloud。

阿里云(国内):Moltbot on AliYun | Model Studio 指南。和 Alibaba Cloud 是同一家公司,但司法管辖区不同。阿里云把它叫做 Moltbot——框架一样,基础设施在中国大陆。

微信方案

如果你在国内,日常生活已经在微信里,腾讯 QQ 的 QClaw 是完全跳过部署环节的选择。智能体就是微信里的一个联系人,直接发消息就行。不需要服务器,不需要任何配置。

腾讯深圳总部当时有上千人排队去安装它。这个数字能说明,零门槛对微信用户究竟意味着什么。

模型问题

这是我一开始做错的地方,也是大多数人低估的地方。

你接上 OpenClaw 的模型,决定了整件事是感觉流畅还是感觉坏掉了。这不是细节问题。

我试过用 GLM 4.7 和 GLM 5.0 处理任务。两个都是有能力的模型。问题是延迟。Claude 或者 GPT-5.4 几秒就能回答的问题,它们要整整一分钟才能返回结果。对聊天界面来说是让人头疼的。对一个全天候运行定时任务、处理你消息的系统来说,就会彻底崩溃。

问题是慢慢累积出来的。你发了一条消息,等着。是在处理?是卡住了?你又试了一次。现在队列里有两个请求了。最终你等了三分钟才得到一个本来五秒就该完成的事情。到了这一步,这个系统不再有用,只是一个持续制造焦虑的来源。

快速可靠能完成的实际工作,比强大但缓慢更多。这个道理我是搞坏了几样东西才真正信的。

高质量任务——写作、推理、复杂研究——我用 Claude Sonnet,通过 claude.ai 或者 API。这个不能省。

批量任务如分类、摘要、轻量处理,开源模型够快而且便宜得多:

- 阿里云 Bailian Coding Plan — GLM-5、Qwen 3.5、Kimi K2.5、MiniMax M2.5;最低付费套餐每月最多 90,000 个请求。国内,阿里巴巴数据政策。

- Alibaba Cloud 同等方案 — 相同模型,国际司法管辖区。

- 腾讯云 Coding Plan — 类似定价,腾讯基础设施。

- 偏好留在中国云之外:OpenCode Go $10/月,相同模型访问。

需要事实准确的研究,我用 Perplexity Search API。每个答案都有引用来源,不会用听起来合理的内容填补空白。

在你把任何模型放入定期任务之前:用一个简单提示加计时器测试响应时间。不要依赖跑分。你实际买到的是真实条件下的延迟。

是这样的

当我早上打开 Discord,事情已经发生了。有一份覆盖我追踪话题的动态摘要——AI 基础设施、SRE、Web3、云计算。三个社交账号的草稿内容。一个我一直在做的私人项目的快照。

全都没有发布。全都落在频道里。我读一读,决定哪些值得用,然后采取行动。

流程里实际跑的是什么、每个任务在做什么、以及一个真实早晨的输出是什么样的:下一篇。

这是关于 AI 工具栈系列的一部分。上一篇讲访问、付款和订阅:香港 AI 设置。下一篇讲 OpenClaw 实际做什么——研究流程,以及你醒来之前已经出现的东西。